AIの「ブラックボックス問題」が解ける日——Anthropicの自然言語オートエンコーダーが開く”解釈可能なAI”時代

「なぜAIはこの判断を下したのか?」——この問いに答えられないことが、AI技術の社会実装における最大の障壁となっている。医療診断、融資審査、採用選考など、人生を左右する場面でAIが使われる時代に、その判断根拠を説明できないことは単なる技術的課題ではなく、社会的信頼の問題だ。Anthropicが発表した「自然言語オートエンコーダー(NLAs)」は、このブラックボックスを開く革新的なアプローチとして注目を集めている。

AIの「思考」は数字の海に沈んでいる

ClaudeやGPTのような大規模言語モデル(LLM)は、私たちが入力した言葉を直接処理しているわけではない。実際には、単語やフレーズを「活性化値」と呼ばれる数百万〜数十億次元の数値ベクトルに変換し、その数字の海の中で情報処理を行っている。例えば「猫」という単語は、[0.234, -0.891, 0.456, …]といった膨大な数字の列として表現される。

この仕組みはAIに高度な言語理解を与える一方で、重大な副作用をもたらした。AIが何を「考えて」いるのか、人間には全く読み取れないのだ。数百万個の数字を眺めても、そこに「動物」「ペット」「かわいい」といった概念が含まれているかは判別不可能。これが「ブラックボックス問題」の本質である。

翻訳ではなく「逆翻訳」——自然言語オートエンコーダーの独創性

Anthropicのアプローチは、従来の説明可能AI(XAI)技術とは一線を画す。一般的なXAI手法は、AIの判断結果を「事後的に」説明しようとする。つまり、結果が出た後に「おそらくこういう理由でしょう」と推測する逆算アプローチだ。

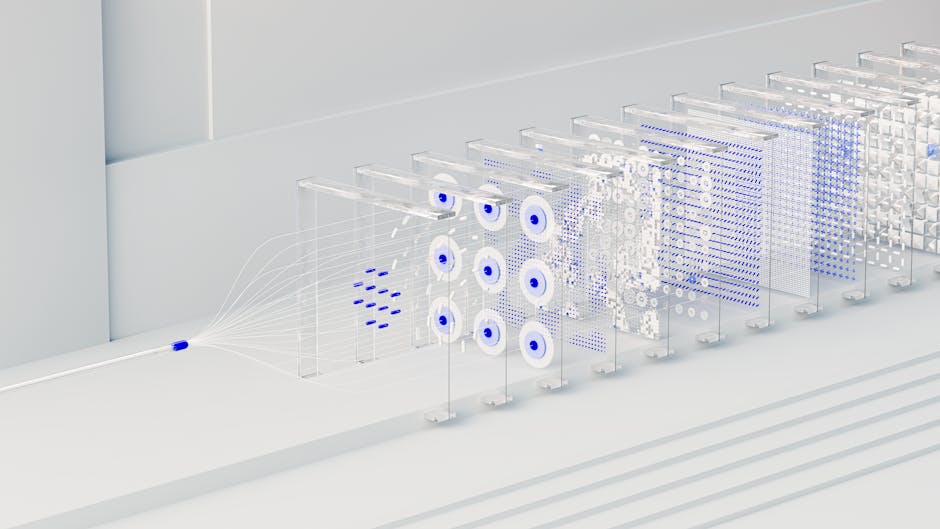

対して自然言語オートエンコーダーは、AIの内部処理プロセス自体を「リアルタイムで」可視化する。具体的には以下の2段階で動作する:

- エンコード: 人間が読める自然言語を、AIが理解する活性化値に変換

- デコード: AIの活性化値を、人間が理解できる自然言語に逆変換

この往復変換により、AIの「思考の瞬間」を言葉として捉えられる。例えば、AIが文章を生成する際、内部では「主語を探している」「感情的なトーンを調整中」「反論を予測している」といった中間的な”意図”が発生する。NLAsはこれらを「主語検索モード」「感情調整:ポジティブ傾向」といった人間が読める形で表示できる。

規制対応だけじゃない——AI開発そのものが変わる

この技術の価値は、AI規制への対応にとどまらない。EU AI法やアルゴリズム説明責任法など、世界各国でAIの透明性を求める規制が強化される中、NLAsは法的要件を満たす強力なツールとなる。しかしより重要なのは、AI開発プロセス自体の効率化だ。

現在のAI開発は「試行錯誤の繰り返し」だ。モデルが期待通りに動かないとき、開発者は膨大なログデータを分析し、どの層で何が起きているか推測するしかない。NLAsがあれば、「第12層で文脈理解が失敗している」「感情分析が第8層で過剰反応している」といった診断が言語レベルで可能になる。これはソフトウェア開発におけるデバッガーの登場に匹敵する革新だ。

さらに、AIの倫理的バイアスの検出にも応用できる。モデルが特定の属性(人種、性別など)に対して不公平な処理をしている場合、その「思考パターン」を言語化することで、バイアスの根源を特定し修正できる。従来は結果の統計分析でしか検出できなかったバイアスを、発生メカニズムレベルで理解できるようになる。

「読める」だけでは不十分——精度と情報損失の課題

ただし、この技術には限界もある。最大の課題は「情報の損失」だ。数百万次元の活性化値を数百語の自然言語に圧縮する過程で、必然的に情報は失われる。Anthropicの初期実験では、NLAsで変換した情報を再びAIに入力すると、元の活性化値の約70〜80%の情報しか保持できなかったという。

また、「言語化できる思考」と「本当の思考」のギャップも存在する。人間の直感が言葉にできないように、AIの情報処理にも言語化困難な側面がある。NLAsが示す説明は、AIの思考プロセスの「解釈」であり「完全な再現」ではない点は理解しておく必要がある。

AIの「内面」が見える時代へ——透明性が競争優位になる

自然言語オートエンコーダーの登場は、AI業界における競争軸の変化を予感させる。これまでAI企業は性能(精度、速度)で競ってきたが、今後は「透明性」「解釈可能性」が新たな差別化要因となるだろう。

特にエンタープライズ市場では、導入企業がAIの判断根拠を理解し、説明責任を果たせることが必須要件になる。「高性能だが説明できないAI」よりも「やや性能は劣るが透明性の高いAI」が選ばれる時代が来るかもしれない。

さらに長期的には、AIと人間のコラボレーションモデルも変わる。AIの思考プロセスが可視化されれば、人間は「結果を受け取る」だけでなく「思考途中で介入し、軌道修正する」ことが可能になる。これは単なる「人間がAIを使う」関係から、「人間とAIが協働思考する」関係への進化を意味する。

ブラックボックスを開くことは、AIへの恐怖を理解に変え、不信を信頼に変える第一歩だ。Anthropicの挑戦は、技術的イノベーションであると同時に、AI社会の成熟に不可欠な”透明性インフラ”の構築なのである。

コメントを送信